Nel rispetto dell’alternanza proposta negli ultimi tempi, questa settimana torneremo ad occuparci dei sensori digitali. Nell’ultima puntata, avevamo fatto la conoscenza con alcuni parametri che contribuiscono a determinare importanti caratteristiche di un sensore e avevamo iniziato ad introdurre il discorso sul rumore, parlando, in particolare, dell’incidenza sullo stesso delle tre componenti della crominanza. Questa settimana, vorrei riprendere il discorso sul cosiddetto rumore digitale e sulle sue componenti. Per farlo, sarà necessario introdurre, seppure a grandi linee, l’architettura a livello di schema a blocchi di un sensore digitale.

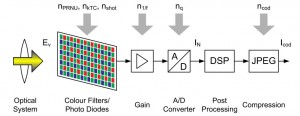

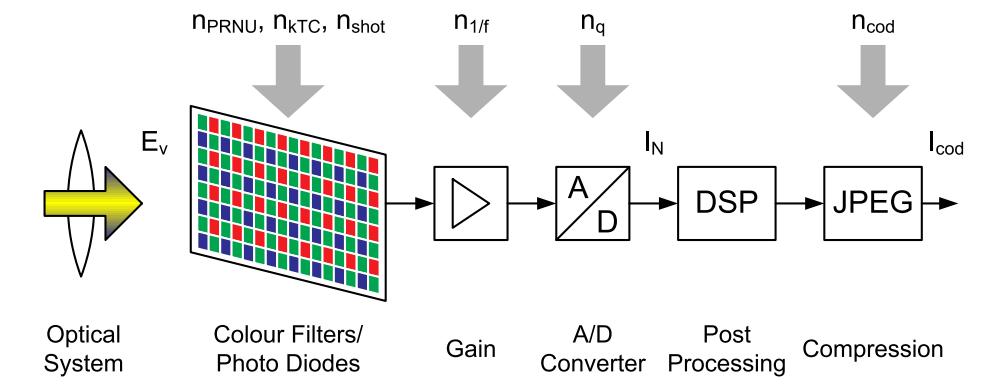

Già da questo primo schema, è evidente che le componenti di quello che viene comunemente definito rumore digitale sono molteplici e diverse tra loro. Oltre alle tre componenti connesse alle operazioni di acquisizione dell’immagine da parte della superficie fotosensibile, indicate, rispettivamente, con n(PNRU) (photoresponse non-uniformity), p(shot) che comprende il photon noise e il dark current noise ed n(KTc) o reset noise, si vedono anche il read noise (o amplifier noise) indicato con n(1/f), il rumore di quantizzazione recante la sigla n(q) e n(cod) ossia il rumore introdotto dalla codifica, ossia dalla compressione in formato non lossless. In seguito, andremo ad analizzare un po’ più da vicino queste componenti tra cui non figurano altri tipi di disturbo di cui si è già parlato in altre sedi, come ad esempio il moire.

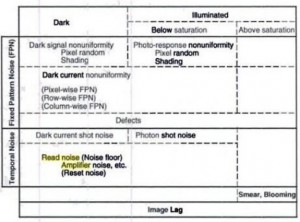

Oltre che sullo stadio dell’elaborazione in cui compare il rumore, una ulteriore suddivisione può farsi basandosi sull’attività del sensore e dei circuiti a valle dello stesso. In questo caso, si scopre che, ad esempio, mentre il rumore dovuto alla dark current è un fenomeno intrinseco al tipo di materiale di cui è composta la giunzione e si manifesta anche quando nessun fotone colpisce il sensore, il rumore dovuto alla PRNU si manifesta quando la radiazione colpisce i fotositi e prima che il sensore raggiunga la saturazione.

Infine, un ulteriore criterio di suddivisione del rumore può essere quello che ci permette di classificarlo in base alla tipologia del suo pattern specifico; possiamo, quindi distinguere il rumore di tipo fixed pattern (come ad esempio quello da dark current) da quello dovuto a transitori (come il reset noise). Questa ulteriore classificazione è particolarmente importante per chi progetta sensori, perchè il fixed pattern noise è facilmente trattabile, al contrario del temporal noise.

Questi ultimi due criteri di classificazione si possono schematizzare nella tabella seguente

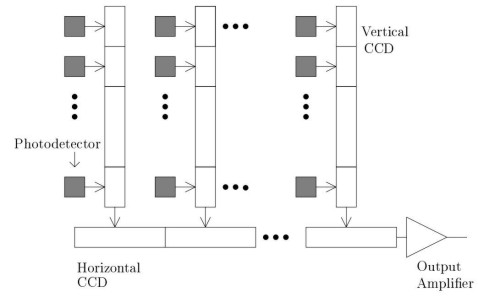

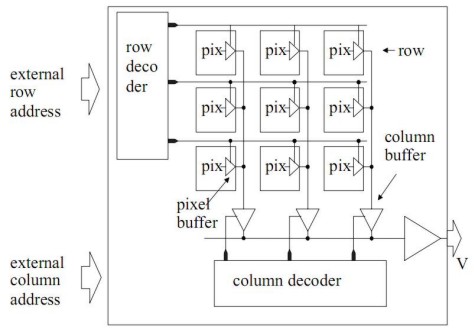

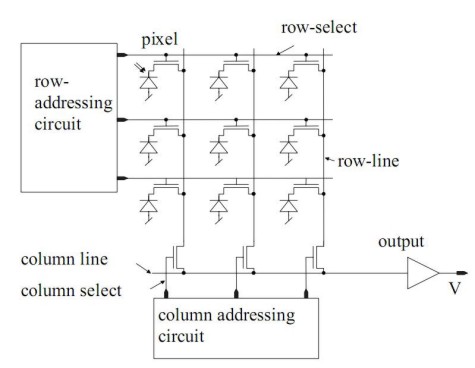

A questo punto, occorre iniziare a fare un primo distinguo tra le diverse tecnologie alla base dei sensori digitali. Per cui mettiamo da parte temporaneamente l’analisi delle componenti del rumore limitandoci a prendere in considerazione, di volta in volta, solo quella attinente alla specifica trattazione del momento. Come abbiamo visto, il punto di partenza comune a tutti è la presenza di una superficie formata da celle in grado di catturare la luce incidente. Già da qui, però, occorre fare un primo distinguo tra CCD e CMOS. Nelle due figure successive sono riportati, rispettivamente, un esempio di un sensore a CCD e di uno a CMOS di tipo APS (active pixel sensor, per distinguerlo dai CMOS di tipo passivo).

Dove il primo è un CCD di tipo INTERLINE (in seguito spiegherò la differenza con, ad esempio, un FULL FRAME con entrambi i termini riferiti alla capacità di trasferimento delle cariche e non alle dimensioni del sensore).

Dalle immagini mostrate, appare evidente una prima sostanziale differenza tra le due tipologie di sensori: in un CCD la carica raccolta dai fotositi è immagazzinata in dei registri a scorrimento verticali ed orizzontali ed è trasferita verso l’uscita del sensore senza alcun tipo di trattamento. E’ presente uno stadio di amplificazione per ogni canale di read out (nell’esempio dell’immagine c’è un solo canale). Nei CMOS, invece, a chi ha un po’ di pratica con la simbologia di tipo elettronico, non sarà sfuggita la presenza di uno stadio di amplificazione su ogni singolo pixel, oltre che su ogni colonna e, infine, su ciascun read out channel.

La presenza di elettronica sul sensore e, addirittura, in ciascun pixel, introduce, come si vede dalla precedente tabella, un rumore extra nei CMOS, a livello di singolo pixel. In precedenza avevamo visto come la corrente di buio sia originata dalla polarizzazione inversa di una giunzione p-n.Questa componente della corrente totale presente ha un moto contrario rispetto a quello della corrente generata dalle coppie elettrone-lacuna formatesi a causa della radiazione incidente e costituisce uno dei tipi di rumore sin qui elencati.

Sui sensori CMOS di tipo attivo, la presenza di uno stadio di amplificazione per ogni pixel dà origine ad un’altra componente di rumore non di tipo fixed pattern. Mentre il reset noise è presente in entrambi i tipi di sensore. A ciò si deve aggiungere che la tecnologia CMOS per i sensori digitali sta solo da qualche anno raggiungendo un livello di maturità comparabile a quella di tipo CCD. Uno degli effetti di questo ritardo, nel corso degli anni, era che la corrente di buio dei CMOS era notevolmente superiore a quella dei CCD e questo contribuiva a diminuire la loro gamma dinamica. Inoltre, le prime implementazioni della tecnologia MOS prevedevano il ricorso a sensori di tipo passivo, ossia con solo un elemento fotosensibile ed uno switching mosfet per ogni pixel.

Come è facile intuire, questo portava a progettare sensori con caratteristiche di funzionamento simili ai CCD ma senza la qualità dei CCD. L’idea alla base di questa scelta progettuale, che poi è la stessa dei CCD, è che si cerca di massimizzare l’area riservata alla cattura della luce. Inoltre, un siffatto circuito è piuttosto semplice da progettare e realizzare e ha determinato la nascita della leggenda metropolitana relativa al minor costo dei CMOS rispetto ai CCD.

In effetti, nel caso dei sensori CMOS passivi non si tratta di una leggenda, in quanto, come è facile intuire, questo tipo di dispositivi sono qualitativamente inferiori ai CCD e sono spesso destinati alla fascia di prodotti più bassa, anche in virtù del fatto che occupano uno spazio molto limitato e sono economici da produrre. Ben diverso il discorso relativo ai ben più costosi e complessi APS, i cui costi di progettazione superano di gran lunga quelli dei CCD. Su questo argomento vale la pena di soffermarsi un po’ per cercare di capire i motivi che stanno portando i vari produttori ad adottare sempre più frequentemente sensori di tipo CMOS per apparecchi di fascia alta mentre i CCD sono spesso confinati su dispositivi più economici. Per avere un quadro più chiaro della situazione, diamo un’occhiata allo schema seguente

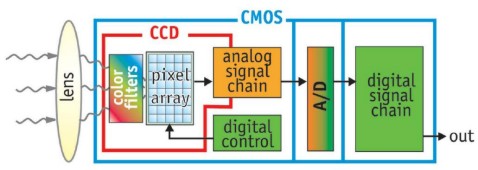

l’immagine riporta il confronto tra un sensore CCD e uno di tipo APS. Come si vede, nel CCD l’output del sensore è dato da una carica elettrica, ovvero un segnale di tipo analogico che deve essere elaborato a valle del sensore stesso. In un CMOS, invece, tutti i circuiti deputati all’elaborazione del segnale sono presenti sul sensore stesso; abbiamo visto che un primo stadio di amplificazione, di verifica della qualità del segnale e del valore del SNR è già presente a livello di singolo pixel. Inoltre, il prodotto finito, in uscita da un sensore CMOS è un segnale digitale e non una carica elettrica.

Questo porta a due considerazioni: un sensore APS ha, rispetto al CCD, una parte più ampia della superficie dedicata ad elementi circuitali che non si occupano di catturare la luce incidente. Un CCD, per la natura intrinseca del suo principio di funzionamento, ha bisogno di tensioni di alimentazione dei circuiti di clock molto più elevate per funzionare correttamente; infatti, si ha la necessità di sincronizzare perfettamente tutte le operazioni di charging/resetting dei registri a scorrimento e questo rende preponderante il reset noise che, essendo di tipo temporal è anche difficile da trattare.

In base a queste considerazioni, dunque, un CMOS ha meno superficie utile per catturare la luce, almeno nella sua versione FSI (front side illuminated), presenta un maggior rumore di tipo temporal dovuto alla presenza degli stadi di amplificazione ed elaborazione del segnale su ogni singolo pixel ma mostra un molto più contenuto valore di reset noise.

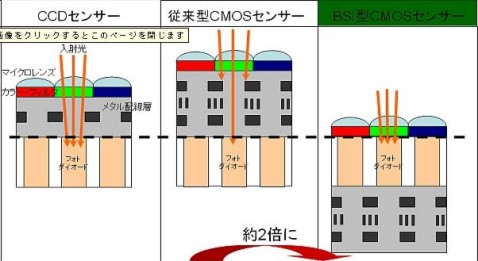

Il problema della minor superficie utile alla cattura dei fotoni è stato risolto con la diminuzione delle dimensioni degli elementi circuitali e con l’adozione di lenti sempre più sofisticate e in grado di catturare la stragrande maggioranza della radiazione incidente per dirottarla sui fotositi; la situazione migliora ulteriormente con l’adozione della tecnologia BSI (back side illuminated) che si oppone alla molto più diffusa FSI (front side illuminated) in quanto posiziona i circuiti elettronici nella parte inferiore del sensore anzichè in quella superiore, come illustrato in figura dove, a termine di confronto, è presente anche un CCD

Dall’immagine appare evidente che lo strato contenente i circuiti elettronici e i registri costituisce un ostacolo alla possibilità di catturare luce da parte della sottostante superficie fotosensibile e che lo scopo delle lenti è quello di convogliare la maggior quantità di fotoni tra gli spazi esistenti tra i gruppi di registri e circuiti, verso i fotositi. E’ anche evidente che, per semplici ragioni geometriche, un CCD, il cui strato non fotosensibile si limita ai soli registri, ragion per cui risulta meno profondo, la capacità di catturare luce è maggiore di quella di un APS di tipo CMOS (prossimamente vedremo anche le differenze tra full frame CCD e interline CCD).

Dalle immagini si vede anche che i fotositi non costituiscono un continuum ma sono distanziati tra loro; gli interstizi tra fotositi servono a ridurre gli effetti della diffrazione e delle reciproche interferenze di natura elettrica e il rapporto tra dimensioni dei fotositi e misura di questi “corridoi” decresce al diminuire delle dimensioni degli elementi fotosensibili. Da queste considerazioni appaiono chiari alcuni punti: l’importanza delle lenti; il vantaggio di ridurre le dimensioni dei circuiti elettronici che possono schermare la luce incidente; il vantaggio di adottare un’architettura di tipo BSI.

Dell’importanza delle microlenti si è già fatto cenno; la diminuzione delle dimensioni dei transistor ha permesso ai CMOS di ridurre, fin quasi ad azzerare, il gap con i migliori CCD, in fatto di capacità di catturare fotoni; le architetture BSI, invece, pur non costituendo una innovazione, si stanno iniziando a diffondere solo ora a causa della fragilità strutturale che aveva caratterizzato in passato questo tipo di architetture, elemento che ancora ne impedisce l’adozione per chip di grandi dimensioni.

Dopo aver introdotto, a livello macroscopico, le differenze architetturali tra CCD e CMOS, nel prossimo capitolo torneremo sull’analisi del rumore, prendendo in esame le diverse componenti in relazione agli stadi circuitali che le generano e i sistemi adottati a combatterle. Infine si faranno delle valutazioni sui diversi tipi di sensore, sui vantaggi e gli svantaggi connessi alla loro adozione e su come i parametri esaminati incidano sulle loro prestazioni.